Page 11 -

P. 11

이때 큰 화제가 된 것은 ‘AlexNet을 다른 이미지의 클래스 분류에도 적용할 수 있는가?’였습

니다. AlexNet은 8층의 신경망이지만 그 내부에는 방대한 파라미터가 있고, 토론토대학교의

정예 팀이 GPU를 사용하여 약 2주간에 걸쳐 만든 고성능 모델입니다.

이것을 계기로 ILSVRC에서 만든 고성능 모델의 구조 및 파라미터를 오픈 소스(open source)로

공개했습니다. 이러한 모델을 사전 학습된 모델(pre-trained model)이라고 하는데, 사전 학습된 모

델을 이용하면 쉽게 성능을 낼 수 있습니다.

이미지 클래스 분류에서는 이러한 사전 학습된 모델을 주로 사용합니다. 이 책에서는 VGG-

16, ResNet-152의 사전 학습된 모델을 이용한 사례를 4장에서 설명합니다.

또 예측 정확도를 더욱 향상시키는 다음 기법도 소개합니다.

첫 번째는 데이터 확장, 전처리라고 하는 사전 처리 기법으로, 모델의 예측 정확도를 향상시키

는 중요한 과정입니다.

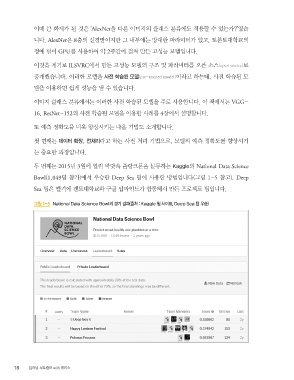

두 번째는 2015년 3월에 열린 바닷속 플랑크톤을 분류하는 Kaggle의 National Data Science

Bowl(1,049팀 참가)에서 우승한 Deep Sea 팀이 사용한 방법입니다(그림 1-5 참고). Deep

Sea 팀은 벨기에 겐트대학교와 구글 딥마인드가 합동해서 만든 프로젝트 팀입니다.

그림 1-5 National Data Science Bowl의 경기 결과(출처 : Kaggle 웹 사이트, Deep Sea 팀 우승)

18 딥러닝 부트캠프 with 케라스

딥러닝 부트캠프(본문)최종.indd 18 2017-12-06 오후 3:25:37